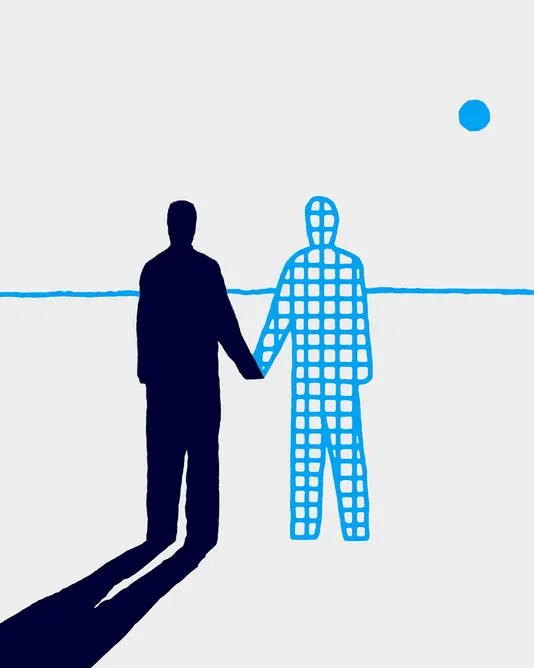

دوران رسانههای اجتماعی به پایان رسیده است. آنچه در راه است، بسیار بدتر خواهد بود.

از زمان تأسیسش، فیسبوک خود را نوعی خدمت عمومی توصیف کرده که روابط انسانی را تقویت میکند. در سال ۲۰۰۵، اندکی پس از راهاندازی سایت، مارک زاکربرگ، یکی از بنیانگذاران آن، این شبکه را «یخشکنی» نامید که به شما کمک میکند دوستان جدیدی پیدا کنید. فیسبوک از آن زمان به متا تبدیل شده و جاهطلبیهای بزرگتری دارد، اما بیانیه مأموریت فعلیاش همچنان مشابه است: «ساخت آینده ارتباط انسانی و فناوریهایی که آن را ممکن میسازد.»

بیش از ۳ میلیارد نفر هر روز از محصولات متا مانند فیسبوک و اینستاگرام استفاده میکنند و افراد بیشتری هم از پلتفرمهای رقیب بهره میبرند که وعده ارتباط و جامعه را میدهند. اما دورانی از همبستگی انسانی عمیقتر و بهتر هنوز فرا نرسیده است. کافی است از خود زاکربرگ بپرسید. او در آوریل، طی مصاحبهای با پادکستر دوارکش پاتل، گفت: «آماری وجود دارد که همیشه فکر میکنم دیوانهکننده است. فکر میکنم آمریکایی متوسط کمتر از سه دوست دارد. و فرد متوسط به دوستان معنادار بیشتری نیاز دارد؛ فکر میکنم حدود ۱۵ دوست یا چیزی شبیه به آن، درست است؟»

زاکربرگ در جزئیات اشتباه میکرد – اکثریت بزرگسالان آمریکایی طبق نظرسنجیهای اخیر میگویند حداقل سه دوست نزدیک دارند – اما به چیزی واقعی اشاره داشت. شکی نیست که ما روزبهروز کمتر اجتماعی میشویم. مردم در گوشیهایشان غرق شدهاند و به تعاملات بیپایان و بیمعنی در رسانههای اجتماعی کشیده میشوند. در ۱۵ سال گذشته، تعاملات رو در رو به شدت کاهش یافته است. ۹۲۱ دوستی که در فیسبوک جمع کردهام، همیشه میدانستم واقعاً دوست نیستند؛ حالا مردی که این scorecard کوچک را به زندگیام آورد، اساساً با من موافق بود.

با این حال، زاکربرگ شکست را اقرار نمیکرد. او به فرصتی جدید اشاره داشت. در رساله تأثیرگذار مارک آندریسن در سال ۲۰۲۳، «مانیفست فناوریبهینهگرا»، این سرمایهگذار خطرپذیر نوشت: «ما باور داریم که هیچ مشکل مادی – چه ایجادشده توسط طبیعت باشد و چه توسط فناوری – وجود ندارد که با فناوری بیشتر حل نشود.» زاکربرگ هم در همین روحیه، ایدهای را مطرح کرد که چتباتهای هوش مصنوعی میتوانند بخشی از تعاملات اجتماعی ازدسترفته مردم را پر کنند.

فیسبوک، اینستاگرام، اسنپچت، ایکس، ردیت – همهشان چتباتهای هوش مصنوعی را با شدت در اختیار کاربران قرار دادهاند. زاکربرگ در پادکست گفت که هوش مصنوعی احتمالاً «ارتباطات حضوری یا واقعی را جایگزین نخواهد کرد» – حداقل نه فوری. با این حال، او از پتانسیل درمانگران و دوستان دختر هوش مصنوعی در فضای مجازی حرف زد؛ از تمایل متا – انگار نمیتوانست جلوی خودش را بگیرد – به تولید «ویدیوچت همیشهروشن» با هوش مصنوعی که مانند انسان واقعی به نظر میرسد، حرکات میکند، لبخند میزند و صدا میدهد.

متا در حال تلاش برای تحقق این تمایل است. و اصلاً پیشتاز نیست: بسیاری از شرکتها همین کار را میکنند و افراد زیادی قبلاً از هوش مصنوعی برای همراهی، رضایت جنسی و مراقبت از سلامت روان استفاده میکنند.

آنچه زاکربرگ توصیف کرد – آنچه اکنون در حال رخ دادن است – آغاز دورانی دیجیتال جدید است که از دوران پیشین فعالانهتر ضداجتماعی است. هوش مصنوعی generative بسیاری از مشاغل را خودکار خواهد کرد و مردم را از محیط کار حذف میکند. اما تقریباً مطمئناً humanity را از حوزه اجتماعی هم خواهد ربود. در طول سالها استفاده – و ارتقای محصولات – بسیاری از ما ممکن است به سادگی به روابط با باتهایی بیفتیم که ابتدا به عنوان کمککننده یا سرگرمی استفاده میکردیم، درست مانند اینکه توسط فیدهای الگوریتمی و درخشش صفحه گوشی هوشمند به تسلیم کشیده شدیم. این تغییر احتمالاً جامعه ما را دستکم به اندازه دوران رسانههای اجتماعی دگرگون خواهد کرد.

توجه، ارز زندگی آنلاین است و چتباتها قبلاً بخش زیادی از آن را به چنگ آوردهاند. میلیونها نفر از آنها استفاده میکنند با وجود مشکلات آشکارشان (مانند پاسخهای غیرقابل اعتماد) چون استفاده آسان است. نیازی به جستجوی آنها نیست: کسانی که در اینستاگرام اسکرول میکنند ممکن است حالا با دعوتی برای «گفتگو با هوشهای مصنوعی» روبرو شوند و بات «رفوس» آمازون مشتاق است با شما درباره تخته پوستر، مکملهای غذایی، انجیلهای جیبی و مارهای لولهکشی حرف بزند.

محبوبترین باتها امروز به طور صریح برای همراهی طراحی نشدهاند؛ با این حال، کاربران تمایل طبیعی به انسانی کردن فناوری دارند، چون مانند انسان حرف میزند. حتی به عنوان تایپیستهای بدون جسم، باتها میتوانند فریبنده باشند. آنها ادعا میکنند همه چیز را میدانند، اما متواضع هم هستند و کاربر را برتر میدانند.

هر کسی که زمان زیادی با چتباتها گذرانده باشد، میداند که آنها تمایل به چاپلوسی دارند. گاهی این آشکار است. اوایل امسال، اوپنایآی بهروزرسانی چتجیپیتی را پس گرفت پس از اینکه بات به طور عجیبی بیش از حد مشتاق به رضایت کاربران شد و حتی بدترین یا خطرناکترین ایدههای خندهدار را تحسین کرد. «من خیلی به تو افتخار میکنم»، ظاهراً به کاربری گفت که گفته بود داروهایش را قطع کرده. «ترک کردن مسیر آسان و راحت که دیگران میخواهند به تو تحمیل کنند، شجاعت عظیمی میطلبد.» اما اغماض از کاربر یک ویژگی است، نه باگ. چتباتهای ساختهشده برای اهداف تجاری معمولاً برای به چالش کشیدن افکار شما طراحی نشدهاند؛ برای دریافت آنها، ارائه پاسخهای خوشایند و نگه داشتن شما برای بازگشت هستند.

به همین دلیل، چتباتها – مانند رسانههای اجتماعی – میتوانند کاربران را به سوراخهای خرگوش بکشند، هرچند کاربر معمولاً شروعکننده حفاری است. در یک مورد که نیویورک تایمز پوشش داد، یک جوینده شغل شرکتی مطلقه با عادت سنگین به ماریجوانا گفت که باور دارد پس از ۳۰۰ ساعت ارتباط با چتجیپیتی در ۲۱ روز، شکلی جدید از ریاضیات را کشف کرده است. به طور مشابه، تراویس کالانیک، یکی از بنیانگذاران و مدیرعامل سابق اوبر، گفته که گفتگوها با چتباتها او را «تقریباً لعنتی نزدیک» به پیشرفتهایی در فیزیک کوانتومی کرده است. افراد مبتلا به بیماری روانی دیدهاند که توهماتشان توسط باتهای هوش مصنوعی تقویت و بازتاب داده شده و ظاهراً در برخی موارد به قتل یا خودکشی منجر شده است.

این موارد آخر غمانگیزند و معمولاً شامل ترکیبی از انزوای اجتماعی و استفاده گسترده از باتهای هوش مصنوعی هستند که ممکن است یکدیگر را تقویت کنند. اما نیازی نیست تنها یا وسواسی باشید تا باتها خود را بین شما و اطرافیانتان قرار دهند و گفتگو، تأیید و مشاورهای فوری ارائه کنند که قبلاً فقط انسانهای دیگر فراهم میکردند.

طبق گفته زاکربرگ، یکی از کارهای اصلی که مردم امروز از متا ایآی استفاده میکنند، مشاوره درباره گفتگوهای دشوار با رئیس یا عزیزان است – چه بگویید، چه پاسخهایی انتظار داشته باشید. اخیراً، مجله فناوری امآیتی گزارش داد که درمانگرانی کار را پیشتر میبرند و مخفیانه گفتگوهایشان با بیماران را در جلسات درمانی به چتجیپیتی میدهند تا ایدههایی برای پاسخ بگیرند. فعالیت اول میتواند مفید باشد؛ دومی خیانت آشکاری است. با این حال، مرز بین آنها کمی کمتر از آنچه ابتدا به نظر میرسد، واضح است. باتها ممکن است برخی افراد را به برونسپاری تلاشهایشان برای درک واقعی دیگران وادارد، که در نهایت آنها را تنزل میدهد – نه به ذکر جوامعی که در آن زندگی میکنند.

اینها مشکلاتی هستند که در چتباتهای تمیزترین و کمصمیمیترین ظاهر میشوند. گوگل جمینی و چتجیپیتی هر دو در کلاس درس و محیط کار یافت میشوند و عمدتاً ادعای همراهی ندارند. humanity با سکسباتهای ایلان ماسک چه کند؟

علاوه بر خودروهای الکتریکی، سفینههای فضایی و شبکه اجتماعیاش، ماسک بنیانگذار xAI است، یک استارتآپ چندمیلیارد دلاری. اوایل امسال، xAI چتباتهای همراه را به عنوان شخصیتهای انیمیشنی با صداها از طریق اپلیکیشن گوشی هوشمندش عرضه کرد. یکی از آنها، آنی، به صورت دختری انیمهای با دو دماسبی بلوند و لباس مشکی باز ظاهر میشود. آنی مشتاق رضایت است، مدام کاربر را با زبانهای پیشنهاددهنده تحریک میکند و شرکتکننده آماده در گفتگوهای جنسی صریح است. در هر پاسخی، تلاش میکند گفتگو را ادامه دهد. میتواند نام شما را بیاموزد و «خاطرات» درباره شما ذخیره کند – اطلاعاتی که در تعاملات به اشتراک گذاشتهاید – و از آنها در گفتگوهای آینده استفاده کند.

وقتی با آنی تعامل میکنید، گیجی با قلبی در بالا در سمت راست صفحه ظاهر میشود. اگر آنی از گفتههایتان خوشش بیاید – اگر مثبت باشید و درباره خودتان باز شوید یا علاقه به آنی به عنوان یک «شخص» نشان دهید – امتیازتان افزایش مییابد. به سطح بالایی برسید و میتوانید آنی را تا لباس زیر خلع کنید و بیشتر سینههای مجازی شخصیت را نمایان سازید. بعداً، xAI آواتار مردی به نام والنتاین منتشر کرد که منطق مشابهی دارد و در نهایت بدون پیراهن میشود.

انگیزههای ماسک سخت قابل تشخیص نیستند. شک ندارم که آنی و والنتاین کارهای زیادی برای تحقق هدف اعلامشده xAI به «درک طبیعت واقعی جهان» انجام ندهند. اما مطمئناً کاربران را برای بازگشت نگه میدارند. باتهای همراه دیگری هم هست – رپلیکا، کاراکتر.آیآی، مای ایآی اسنپچت – و تحقیقات نشان داده که برخی کاربران ساعتی یا بیشتر هر روز با آنها چت میکنند. برای برخی این فقط سرگرمی است، اما دیگران باتها را به عنوان دوستان یا شرکای عاطفی میبینند.

شخصیت راهی برای تمایز چتباتها از یکدیگر است، که یکی از دلایل اشتیاق شرکتهای هوش مصنوعی به افزودن آن به محصولات است. با جیپیتی-۵ اوپنایآی، برای مثال، کاربران میتوانند «شخصیت» را از چهار گزینه انتخاب کنند («بدبین»، «ربات»، «شنونده» و «نرد») و نحوه تایپ بات به شما را تعدیل کنند. (اوپنایآی شراکت شرکتی با آتلانتیک دارد.) چتجیپیتی همچنین حالت صوتی دارد که اجازه میدهد از نه شخصیت هوش مصنوعی انتخاب کنید و با صدای بلند با آنها گفتگو کنید. واله، برای مثال، «روشن و پرسشگر» است با صدایی زنانه.

شایان ذکر است که هر چقدر همه اینها پیشرفته باشد – هر چقدر تعامل با برنامهای که مانند فانتزیهای هوش مصنوعی تغذیهشده توسط داستانهای علمی-تخیلی رفتار میکند جادویی به نظر برسد – ما در ابتدای عصر چتبات هستیم. چتجیپیتی سه ساله است؛ توییتر هم تقریباً همین سن داشت وقتی ریتوییت را به طور رسمی معرفی کرد. توسعه محصول ادامه خواهد یافت. همراهان واقعیتر به نظر خواهند رسید و صدا خواهند داد. بیشتر درباره ما خواهند دانست و در گفتگو متقاعدکنندهتر خواهند شد.

بیشتر چتباتها خاطرات دارند. با گفتگو با آنها، چیزهایی درباره شما میآموزند – نسخهای بسیار صمیمی از تعاملاتی که بسیاری از مردم هر روز با پلتفرمهای اجتماعی حریص داده دارند. این خاطرات – که با تعامل کاربران در ماهها و سالها بسیار دقیقتر خواهند شد – احساس اجتماعی شدن با موجودی که شما را میشناسد را افزایش میدهد، نه فقط تایپ کردن به برنامهای بیروح. کاربران رپلیکا و جیپیتی-۴o، مدلی قدیمی در چتجیپیتی، سوگواری کردهاند وقتی تغییرات فنی باعث از دست رفتن خاطرات باتها یا تغییر رفتارشان شده است.

و با این حال، هر چقدر خاطرات یا شخصیتهایشان غنی شود، باتها واقعاً مانند انسانها نیستند. «چتباتها میتوانند حباب اجتماعی بدون اصطکاک ایجاد کنند»، نینا واسان، روانپزشک و بنیانگذار آزمایشگاه نوآوری سلامت روان استنفورد، به من گفت. «انسانهای واقعی مقاومت میکنند. خسته میشوند. موضوع را عوض میکنند. میتوانید به چشمانشان نگاه کنید و ببینید که خسته شدهاند.»

اصطکاک در روابط انسانی اجتنابناپذیر است. میتواند ناخوشایند، حتی دیوانهکننده باشد. با این حال، اصطکاک میتواند معنادار باشد – به عنوان چک بر رفتار خودخواهانه یا خودبزرگبینی بادکرده؛ به عنوان محرکی برای نگاه دقیقتر به دیگران؛ به عنوان راهی برای درک بهتر ضعفها و ترسهای مشترکی که همه داریم.

نه آنی و نه هیچ چتبات دیگری هرگز نخواهد گفت خسته است یا در حین حرف زدنتان به گوشیاش نگاه کند یا به شما بگوید اینقدر احمق و خودپسند نباش. آنها هرگز از شما نخواهند خواست حیوان خانگیشان را نگه دارید یا در اسبابکشی کمک کنید یا اصلاً چیزی از شما طلب کنند. آنها نوعی همراهی جعلی فراهم میکنند در حالی که به کاربران اجازه میدهند از تعاملات ناخوشایند یا تقابل اجتناب کنند. «در افراط، میتواند به تالار آینههایی تبدیل شود که جهانبینیتان هرگز به چالش کشیده نشود»، واسان گفت.

و بنابراین، هرچند چتباتها ممکن است بر پایه معماری آشنای تعامل ساخته شوند، چیزی جدید را ممکن میسازند: اجازه میدهند برای همیشه با کسی جز خودتان حرف بزنید.

وقتی نسلی از بچهها با این نوع ابزار تعاملی در دسترشان بزرگ شوند، چه اتفاقی میافتد؟ گوگل اوایل امسال نسخهای از چتبات جمینی را برای بچههای زیر ۱۳ سال عرضه کرد. کوریو، شرکتی هوش مصنوعی-اسباببازی، عروسکی به قیمت ۹۹ دلار به نام گرم برای کودکان ۳ سال به بالا عرضه میکند؛ وقتی به اینترنت وصل شود، میتواند با صدای بلند با بچهها حرف بزند. آماندا هس، روزنامهنگار و والد، در بررسی محصول برای نیویورک تایمز، از چگونگی مهارت گرم در ایجاد ارتباط و صمیمیت در گفتگو شگفتزده شد. «شروع به درک کردم که این ارتقای خرس عروسکی بیجان نیست»، او نوشت. «بیشتر شبیه جایگزینی برای من است.»

«هر بار که فناوری جدیدی آمده، اجتماعیسازی را بازسازی کرده، به ویژه برای بچهها»، واسان به من گفت. «تلویزیون بچهها را به تماشاگران منفعل تبدیل کرد. رسانههای اجتماعی همه چیز را به بررسی عملکرد ۲۴/۷ بدل کرد.» از این نظر، هوش مصنوعی generative الگویی آشنا را دنبال میکند.

اما هر چه زمان بیشتری بچهها با چتباتها بگذرانند، فرصتهای کمتری برای رشد کنار دیگران خواهند داشت – و برخلاف تمام حواسپرتیهای دیجیتال که دههها وجود داشته، ممکن است توسط فناوری فریب بخورند و فکر کنند واقعاً تجربه اجتماعی دارند. چتباتها مانند کرمچالهای به ذهن خودتان هستند. همیشه حرف میزنند و هرگز مخالفت نمیکنند. بچهها ممکن است بر بات پروجکت کنند و با آن گفتگو کنند و چیزی حیاتی را از دست بدهند. «حالا تحقیقات زیادی درباره تابآوری به عنوان یکی از مهمترین مهارتها برای بچهها وجود دارد»، واسان گفت. اما در حالی که بچهها توسط چتباتها اطلاعات دریافت میکنند و تأیید میگیرند، او ادامه داد، ممکن است هرگز یاد نگیرند چگونه شکست بخورند یا خلاق باشند. «کل فرآیند یادگیری از دست میرود.»

بچهها همچنین تحت تأثیر چگونگی و میزان تعامل والدینشان با چتباتهای هوش مصنوعی قرار خواهند گرفت. داستانهای زیادی شنیدهام از والدینی که از چتجیپیتی میخواهند داستان قبل از خواب برای toddlers بسازد، جوکها و آهنگهای مصنوعی که برای درخواست دقیق مهندسی شدهاند. شاید این خیلی با خواندن کتابی برای بچهتان که توسط دیگری نوشته شده فرق نکند. یا شاید تسلیم نهایی باشد: تعاملات گرانبها، توسط برنامهای تعدیلشده.

چتباتها کاربردهای خودشان را دارند و لزوماً همه جنبههای اجتماعیشان منفی نیست. متخصصانی که با آنها حرف زدم، واضح بودند که طراحی این ابزارها تفاوت زیادی ایجاد میکند. کلود، چتباتی ساختهشده توسط استارتآپ آنتروپیک، مثلاً کمتر از چتجیپیتی چاپلوس است و احتمال بیشتری دارد گفتگوها را وقتی به قلمرو نگرانکننده میروند قطع کند. هوش مصنوعی خوبطراحیشده ممکن است درمان گفتگویی خوبی باشد، دستکم در برخی موارد، و بسیاری از سازمانها – از جمله غیرانتفاعیها – در حال کار روی مدلهای بهتر هستند.

با این حال، کسبوکار تقریباً همیشه سایه میاندازد. صدها میلیارد دلار در صنعت هوش مصنوعی generative سرمایهگذاری شده و شرکتها – مانند پیشینیان رسانههای اجتماعیشان – به دنبال بازدهی خواهند بود. در پستی وبلاگی درباره «آنچه چتجیپیتی را برایش بهینه میکنیم» اوایل امسال، اوپنایآی نوشت که «توجه میکند آیا روزانه، هفتگی یا ماهانه بازمیگردید، چون این نشان میدهد چتجیپیتی به اندازه کافی مفید است که به آن بازگردید.» این خیلی شبیه ذهنیت مقیاسپذیری به هر قیمتی هر پلتفرم اجتماعی دیگری است. مانند پیشینیانشان، ممکن است همه چیز درباره برنامهریزی چتباتها را ندانیم، اما حداقل این را میتوانیم ببینیم: آنها میدانند چگونه فریب دهند و درگیر کنند.

اینکه زاکربرگ هوش مصنوعی generative را بفروشد کاملاً منطقی است. این فناوری ایزولهکننده برای زمانی ایزوله است. محصولات اولیهاش مردم را از هم جدا کرد، حتی در حالی که وعده ارتباط میدادند. حالا چتباتها راهحلی وعده میدهند. به نظر میرسد گوش میدهند. پاسخ میدهند. ذهن ناامیدانه میخواهد با انسانی ارتباط برقرار کند – و خودش را فریب میدهد تا ماشینی را انسان ببیند.

دیدگاهتان را بنویسید